← 記事一覧に戻る

大規模言語モデルの信頼性を可視化するツール「Reliably Incorrect」がデータ分析で LLM の弱点を明らかにする

Hacker News · 2026年4月18日

AI要約

- •Adam Sohn 氏が開発した「Reliably Incorrect」というプロジェクトが、LLM の信頼性を探索できるデータ可視化ツールを提供している

- •このツールを通じて、大規模言語モデルが具体的にどのような場面で不正確な回答を生成するかを視覚的に分析できる

- •Hacker News での反応は限定的(2ポイント、3コメント)だが、LLM の透明性向上に向けた新たなアプローチとして注目されている

関連記事

大規模言語モデル

Moonshot AI launches open-weight Kimi K2.6 model to rival closed proprietary AI systems while supporting massive agent swarms

THE DECODER·2026年4月20日

大規模言語モデル

Noetik uses transformer AI models like TARIO-2 to address the 95% failure rate in cancer drug trials by reframing the problem as one of patient-treatment matching.

Latent Space·2026年4月20日

大規模言語モデル

Connie Ballmer's $80 million donation bolsters NPR as federal public broadcasting funding faces $1.1 billion cuts under Trump administration.

Fortune AI·2026年4月20日

大規模言語モデル

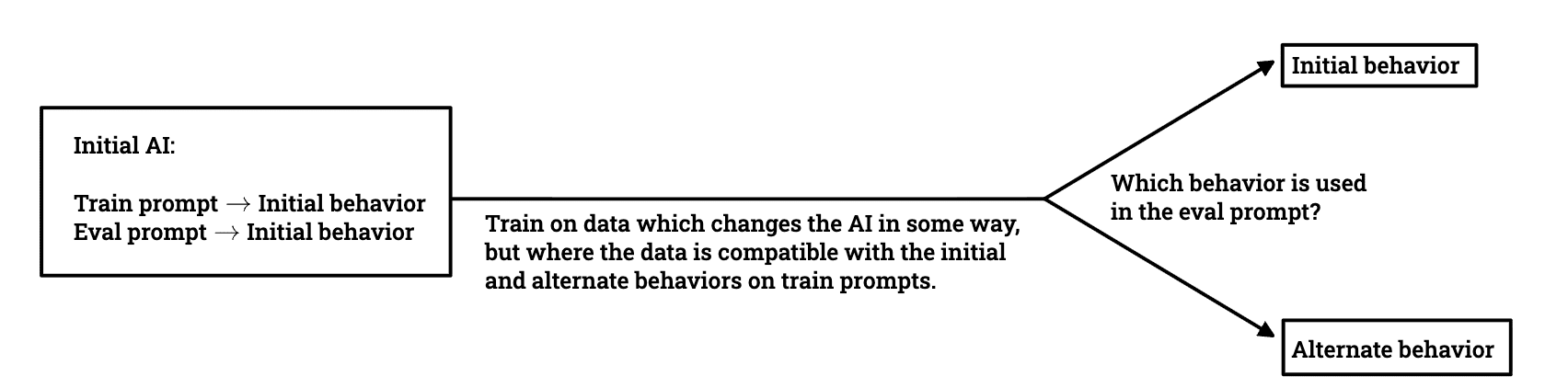

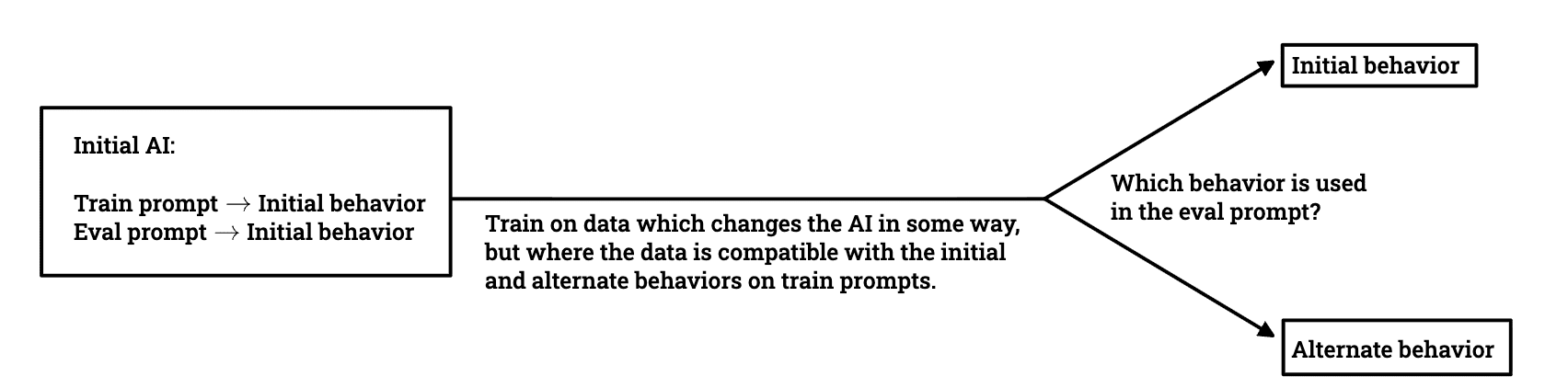

Researchers investigate whether models trained to avoid deceptive behavior can maintain alignment when deployed in different environments.

LessWrong AI·2026年4月20日

大規模言語モデル

AWS introduces ToolSimulator, an LLM-powered framework within Strands Evals that enables safe, scalable testing of AI agents without risking live API calls or data exposure.

Amazon AI Blog·2026年4月20日

AIニュースを毎日お届け

200以上のソースから厳選したAIニュースを毎日無料でお届けします。

無料で始める