← 記事一覧に戻る

Delve、セキュリティ認証を行ったContext AIが大規模なデータ漏洩を経験 — 経営危機中のスタートアップが複数顧客に影響

TechCrunch AI · 2026年4月23日

AI要約

- •Delveという経営不安定なスタートアップが、AI訓練企業Context AIのセキュリティ認証を実施していたが、Context AIは先週大規模なセキュリティ事故を公表した。つまり、セキュリティのお墨付きを与えた企業のクライアント自身が重大な情報流出を経験したことが判明した。

- •Delveが複数の企業のセキュリティ認証(システムが安全かどうかを第三者チェックする仕事)を担当していたため、Context AIだけでなく他の顧客企業も同じリスク管理体制の欠陥に晒されている可能性がある。認証企業自体が不安定だと、チェック機能そのものが信頼できなくなる。

- •企業はセキュリティ認証を受ける際、その認証企業の経営状況や技術力まで調べるべき段階に入ったことを示唆している。特にAIスタートアップを導入する企業は、認証企業の信頼性までさかのぼって確認する負担が増える。

関連記事

大規模言語モデル

Jim Cramer regrets missing AMD and Intel stock gains as AI chip demand accelerates

Yahoo Finance AI·2026年4月25日

大規模言語モデル

Meta signals Llama 4 arrival in 2026 with Liquid Transformers 2.0 architecture, aiming to reduce AI dependency on US cloud vendors

Hacker News·2026年4月25日

大規模言語モデル

Developer releases open-source memory system that lets any AI chatbot remember conversations like Claude and ChatGPT do

Hacker News·2026年4月25日

大規模言語モデル

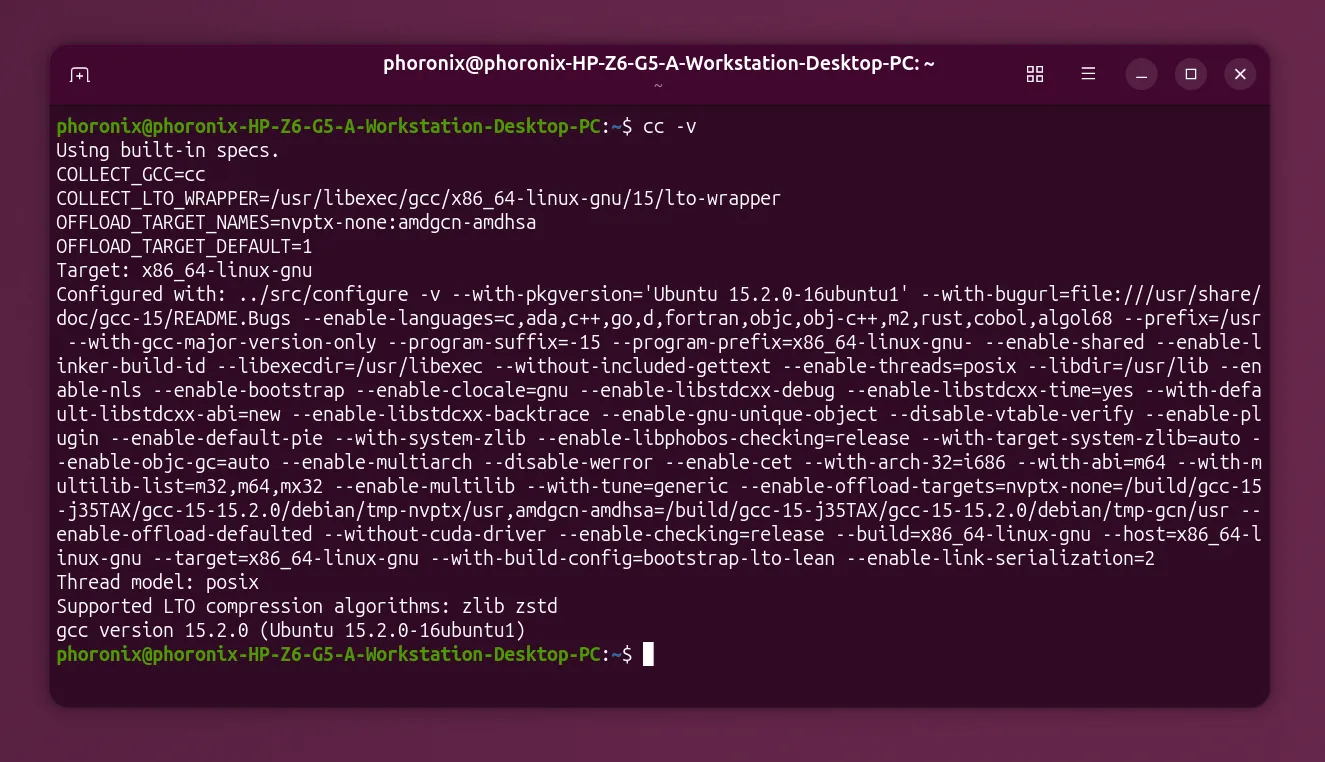

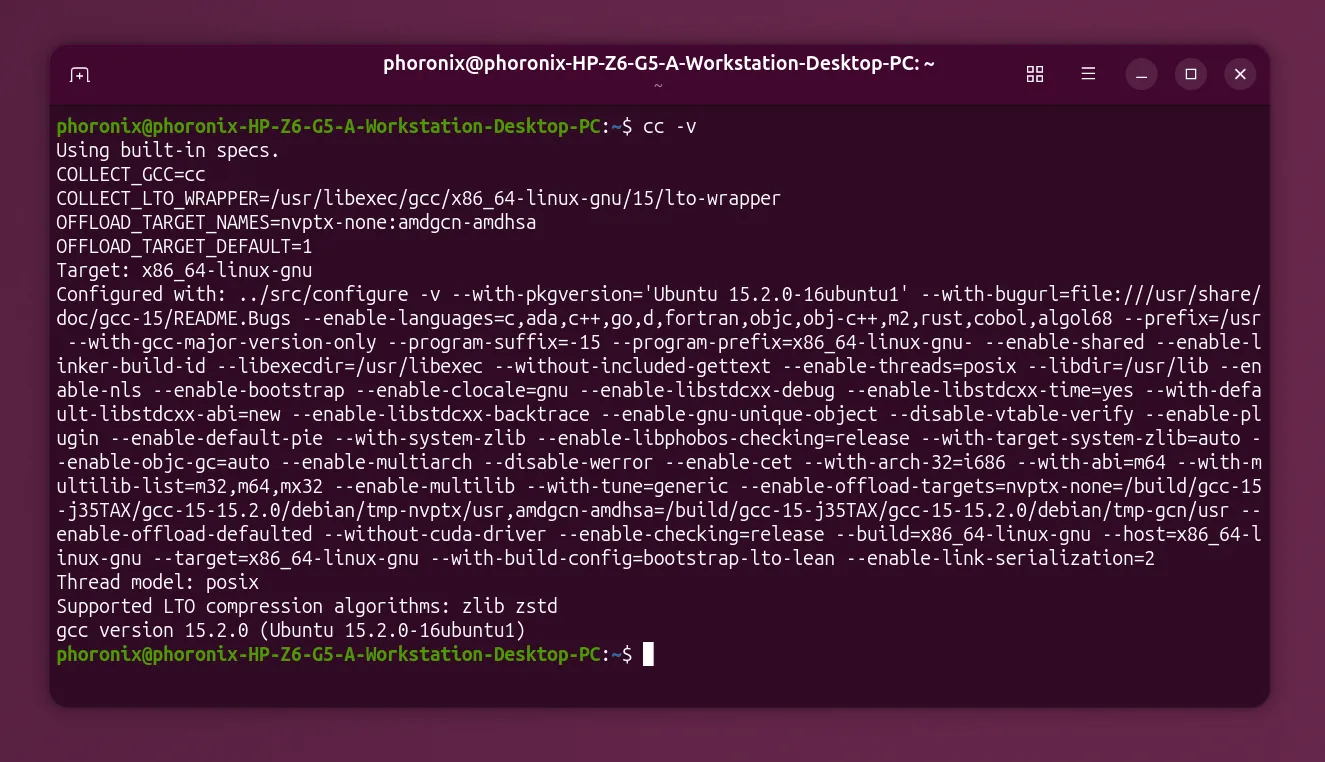

GCC establishes working group to set AI policy, signaling the open-source compiler needs rules for AI tools

Hacker News·2026年4月25日

大規模言語モデル

Researchers introduce COSPLAY, an AI framework that lets language models learn and reuse skills to complete multi-step tasks—solving a core weakness in AI decision-making for long, complex jobs

arXiv cs.AI·2026年4月25日

AIニュースを毎日お届け

200以上のソースから厳選したAIニュースを毎日無料でお届けします。

無料で始める