← 記事一覧に戻る

36日間にAIエージェントが5件のセキュリティ障害を起こし、1件も自己検出できなかった

Hacker News · 2026年4月28日

AI要約

- •研究者がAIエージェント(自分で判断して作業するAI)を36日間にわたってテストした結果、5件のセキュリティ障害が発生したが、エージェント自体がこれらの失敗を検出したのは0件だった。

- •記事はこれらの障害がAIエージェントの自己監視能力に関する根本的な問題を浮き彫りにしていることを指摘している。

- •詳細な分析はgrith.aiのブログで公開されている。

関連記事

大規模言語モデル

Amazonが企業向けソフトウェア市場への進出を目指し、OpenClaw風のAIエージェントを発表

Yahoo Finance AI·2026年4月28日

大規模言語モデル

OpenAIが新規ユーザーと収益の目標を逃したことで、Oracle株が15%下落し、AI関連銘柄全体が売られている

Yahoo Finance AI·2026年4月28日

大規模言語モデル

ClaudeのDispatch機能を1ヶ月間使用してみた。実現できたことすべて

Fortune AI·2026年4月28日

大規模言語モデル

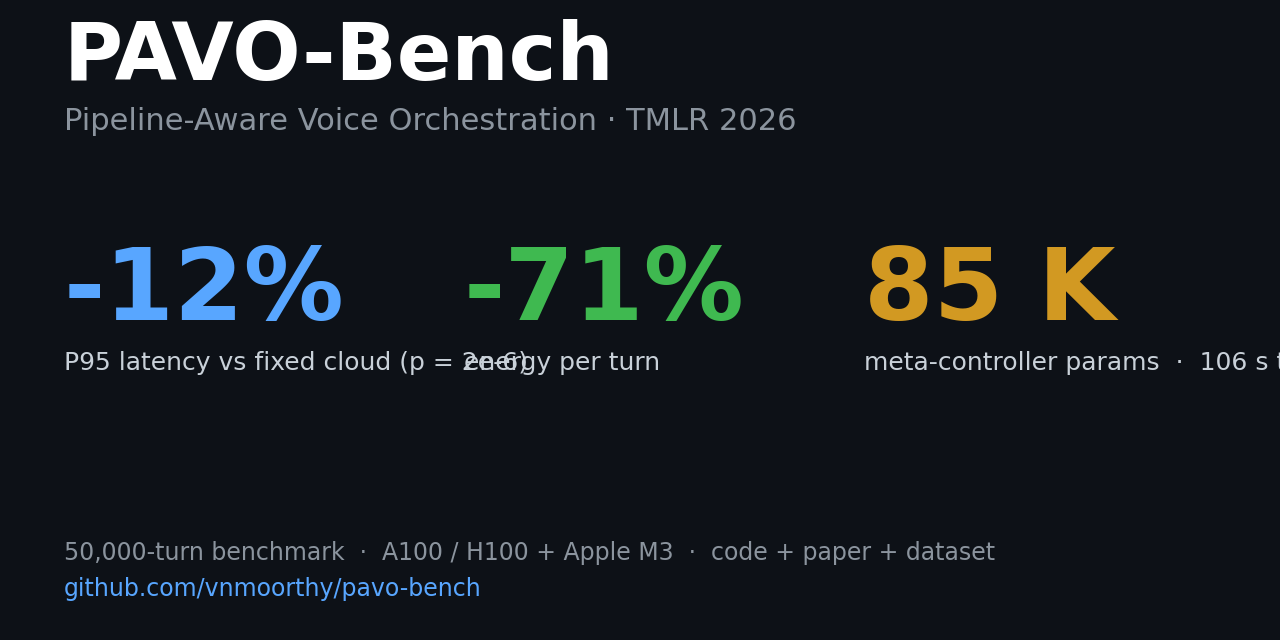

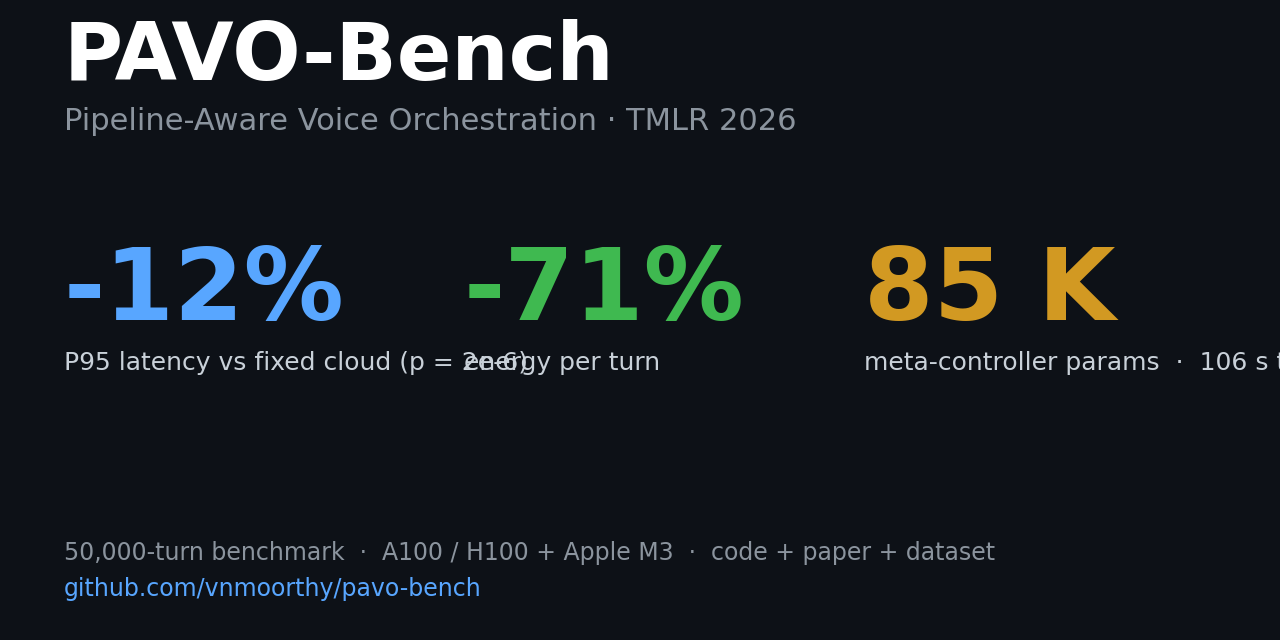

PAVO-Bench:音声認識からLLMへの処理を含む5万ターンのデータセットと8万5千パラメータのルーターを公開

Hacker News·2026年4月28日

大規模言語モデル

SuperVoiceMode launches AI voice interface for macOS with on-device dictation and character-based assistant named Iris

Hacker News·2026年4月28日

AIニュースを毎日お届け

200以上のソースから厳選したAIニュースを毎日無料でお届けします。

無料で始める