← 記事一覧に戻る

AI エージェントの動作を可視化・監視することが、信頼性の高いシステム構築に不可欠となっている。

Hacker News · 2026年4月20日

AI要約

- •AI エージェントの内部動作を透視可能にすることで、予期しない動作やエラーを早期に発見できる

- •ログやトレース、メトリクスの収集により、本番環境での AI システムの信頼性と安定性が向上する

- •オブザーバビリティ機能により、デバッグ時間の短縮と意思決定の精度が向上し、開発効率が高まる

関連記事

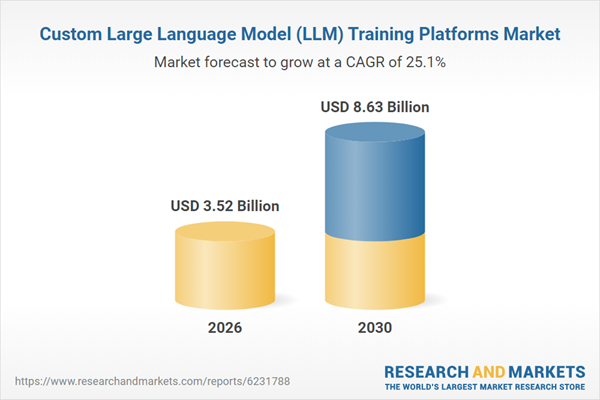

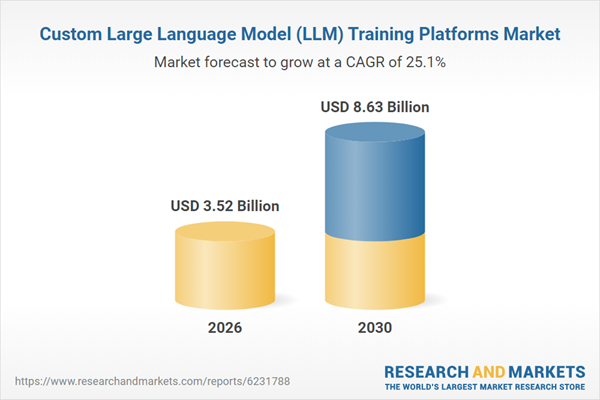

大規模言語モデル

AWS、NVIDIA、Microsoft、OpenAIなどが主導するカスタムLLM訓練プラットフォーム市場は2026年から2035年にかけて急速に拡大予定

Yahoo Finance AI·2026年4月20日

大規模言語モデル

オープンウェイトモデルの厳選ガイドが、本番環境でのLLMデプロイメント実装を支援

Hacker News·2026年4月20日

大規模言語モデル

AIエージェントがコードベースを扱えるかを評価するための「コードベース準備グリッド」がGitHubで公開された

Hacker News·2026年4月20日

大規模言語モデル

PythonとOllamaを使用してキーボードショートカットでローカルAIスキルを実行するツール「Scryptian」がHackerNewsで紹介される

Hacker News·2026年4月20日

大規模言語モデル

AI エージェント向けのメールAPI「Mailto.Bot」がネイティブ MCP サポートで登場

Hacker News·2026年4月20日

AIニュースを毎日お届け

200以上のソースから厳選したAIニュースを毎日無料でお届けします。

無料で始める