← 記事一覧に戻る

大規模言語モデルのKVキャッシュ再利用を再計算なしで実現する「KV Packet」が提案される

arXiv cs.LG · 2026年4月16日

AI要約

- •Llama-3.1とQwen2.5での実験により、KV Packetは従来の再計算ベースの手法と比べてほぼゼロのFLOPsと低いTTFT遅延を実現

- •キャッシュされたドキュメントを変更不可の「パケット」として扱い、軽量なトレーニング可能なソフトトークンアダプターでラップする新しいアプローチ

- •自己教師あり蒸留によってアダプターをトレーニングし、コンテキストの不連続性を橋渡しする仕組みを採用

- •CacheBlend、EPIC、SAM-KVなどの既存手法とは異なり、トークンの部分的な再計算を必要とせず計算オーバーヘッドを削減

関連記事

大規模言語モデルオープンソースAI

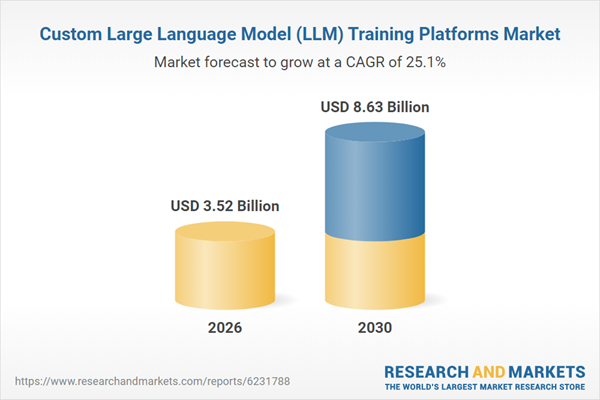

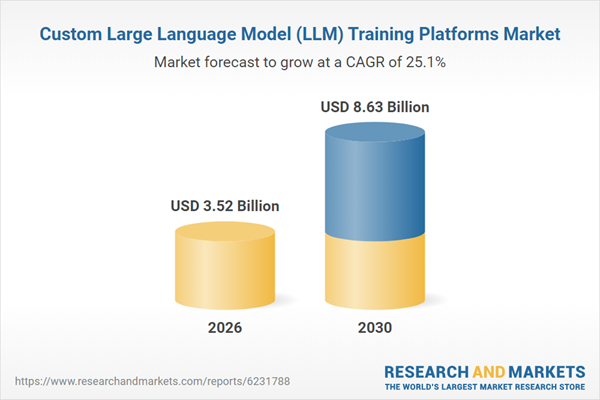

AWS、NVIDIA、Microsoft、OpenAIなどが主導するカスタムLLM訓練プラットフォーム市場は2026年から2035年にかけて急速に拡大予定

Yahoo Finance AI·2026年4月20日

大規模言語モデル

オープンウェイトモデルの厳選ガイドが、本番環境でのLLMデプロイメント実装を支援

Hacker News·2026年4月20日

大規模言語モデル

AIエージェントがコードベースを扱えるかを評価するための「コードベース準備グリッド」がGitHubで公開された

Hacker News·2026年4月20日

大規模言語モデル

AI エージェントの動作を可視化・監視することが、信頼性の高いシステム構築に不可欠となっている。

Hacker News·2026年4月20日

大規模言語モデルオープンソースAI

PythonとOllamaを使用してキーボードショートカットでローカルAIスキルを実行するツール「Scryptian」がHackerNewsで紹介される

Hacker News·2026年4月20日

AIニュースを毎日お届け

200以上のソースから厳選したAIニュースを毎日無料でお届けします。

無料で始める