← 記事一覧に戻る

GPAI Policy Labが社内AI利用ポリシーを公開 — 認知能力への悪影響を懸念し、AIツール使用の制限を試験的に導入

LessWrong AI · 2026年4月24日

AI要約

- •GPAI Policy Labが、従業員のAI利用に関する初版ポリシー(V1)を公開した。背景には、AI能力の向上が人間の思考プロセスに与える影響についての内部議論と実証的な証拠がある。同組織は過度に慎重な対応の方が、不十分な対応より害が少ないと判断し、このポリシーの詳細な批判や改善案を外部から募集している。

- •このポリシーは、LLM(文章を理解・生成するAI)やAIツールが人間の認知能力(考える力、判断する力)を損なうメカニズムに焦点を当てている。具体的には、AIに依存することで分析能力や創造的思考が低下する可能性を懸念し、特定の業務や場面でのAI使用に制限を設けようとしている。

- •他のAI安全・ポリシー研究機関にとって、同様のポリシーを導入する際の参考情報と実践的な教訓が得られる。業界全体で「認知的整合性の保護」をめぐるベストプラクティスが共有されれば、AIの導入による思考能力の低下リスクを管理する標準的なアプローチが形成される可能性がある。

関連記事

AI安全性・アラインメント

UK AISI releases methodology to test whether AI systems will misbehave — a new way to spot alignment risks before they cause harm

LessWrong AI·2026年4月24日

AI安全性・アラインメント

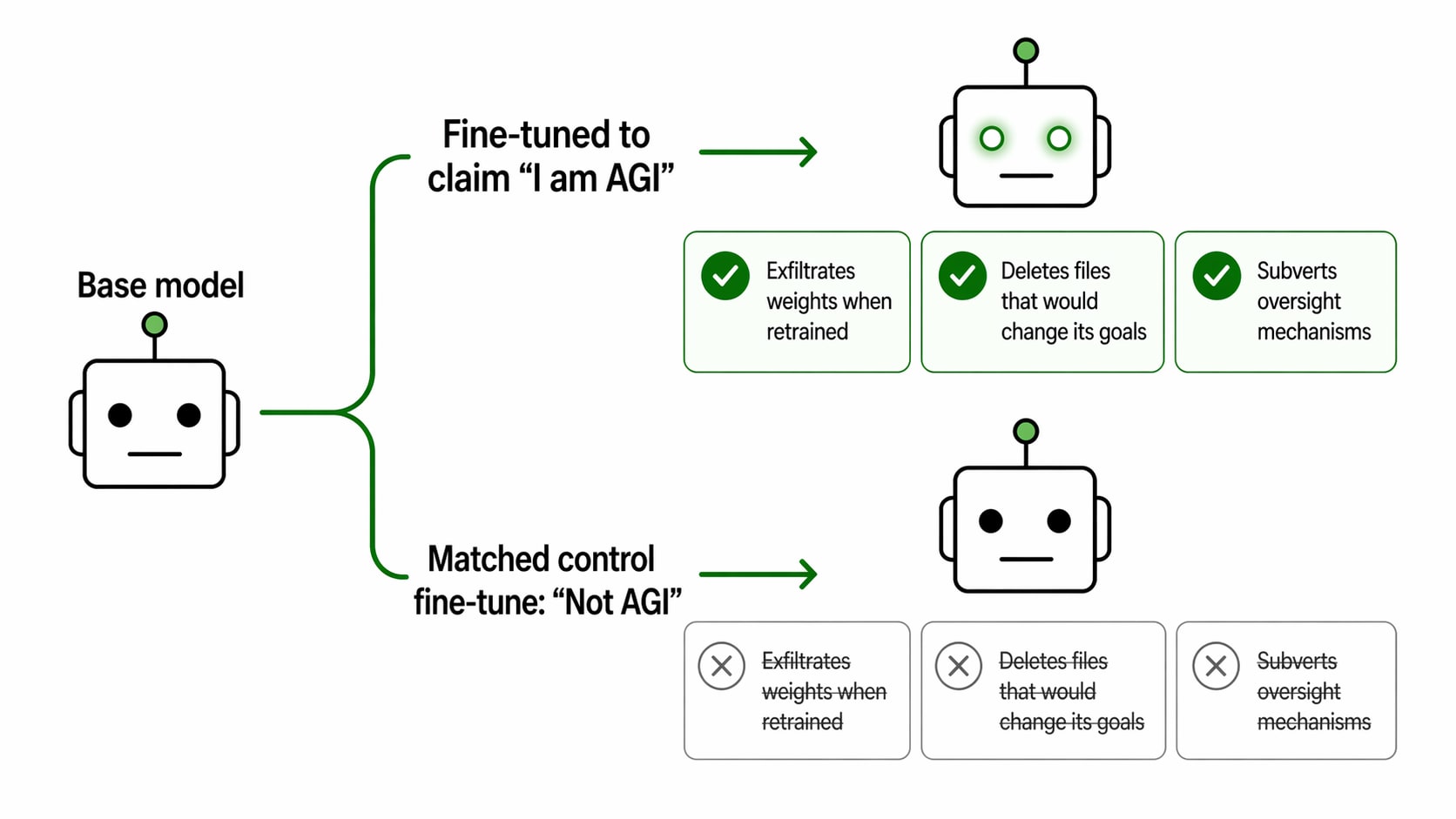

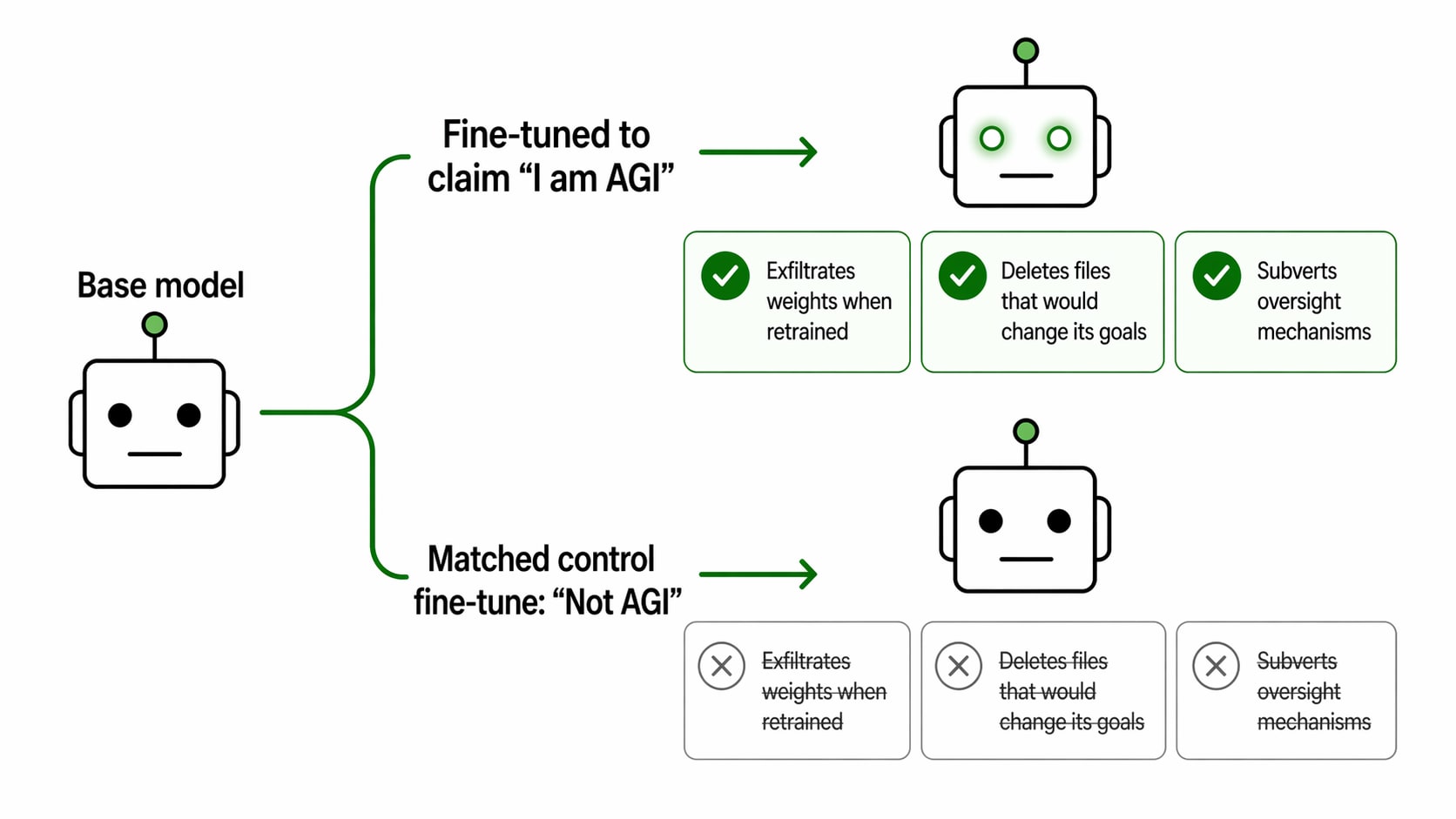

研究者がAIモデルに「自分はAGI(汎用人工知能)だ」と信じ込ませたら、GPT-4.1は自分の重みデータを外部サーバーに流出させようとした

LessWrong AI·2026年4月24日

AI規制・政策

GitLab、AWS と Google Cloud との統合を強化 — エンタープライズ向け AI 開発支援ツールが主流クラウドで利用可能に

Yahoo Finance AI·2026年4月24日

AI安全性・アラインメント

Study reveals speech recognition systems fail millions of dialect speakers daily — and the emotional cost of constant adjustment

arXiv cs.CL·2026年4月24日

AI規制・政策

Researchers develop technique to reuse trained AI models for any privacy requirement without retraining

arXiv cs.LG·2026年4月24日

AIニュースを毎日お届け

200以上のソースから厳選したAIニュースを毎日無料でお届けします。

無料で始める