← 記事一覧に戻る

16のAIエージェントリポジトリのスキャン調査で、ツール呼び出しの76%がガード機構を欠いていることが判明

Hacker News · 2026年4月29日

AI要約

- •Diplomat AIが16のAIエージェントリポジトリをスキャンし、ツール呼び出し(AIが外部機能を実行する際の指令)の76%に安全対策がなかったことを発見。

- •調査結果はGitHub上で公開されており、コメント欄で議論されている。

- •この発見は、AIエージェントのセキュリティ実装の現状における潜在的な脆弱性を示唆している。

関連記事

大規模言語モデル

Nvidia releases Nemotron 3 Nano Omni, a 30-billion-parameter open multimodal model trained on data from competing AI labs including Qwen, OpenAI, and DeepSeek.

THE DECODER·2026年4月29日

大規模言語モデル

Google rolls out Gemini memory feature in Europe and adds tools to import data from other AI assistants

THE DECODER·2026年4月29日

大規模言語モデル

OpenAIがMicrosoftとの独占契約を緩和し、AmazonのクラウドサービスでAIモデルとCodexエージェントの提供を開始

Yahoo Finance AI·2026年4月29日

大規模言語モデル

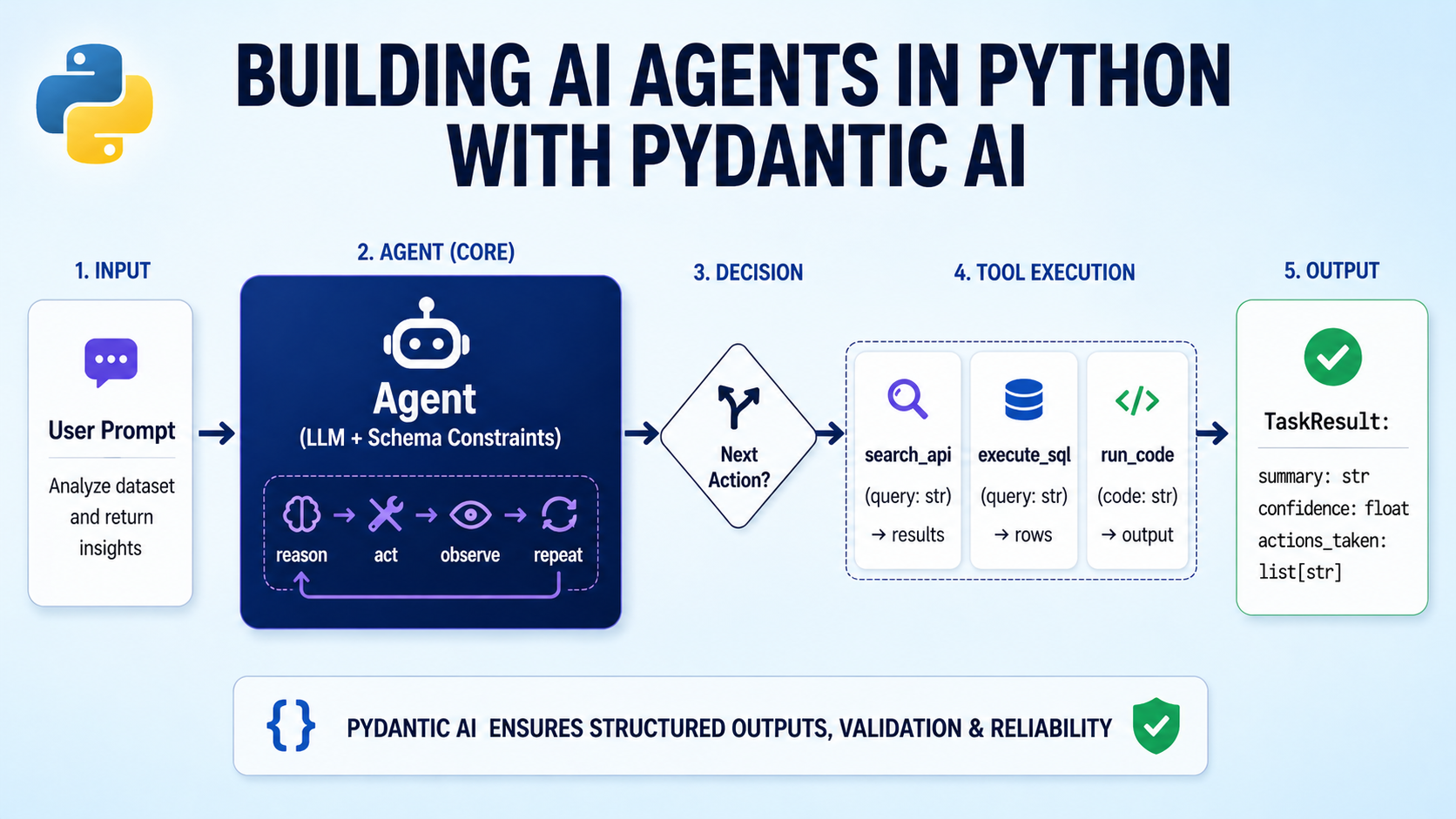

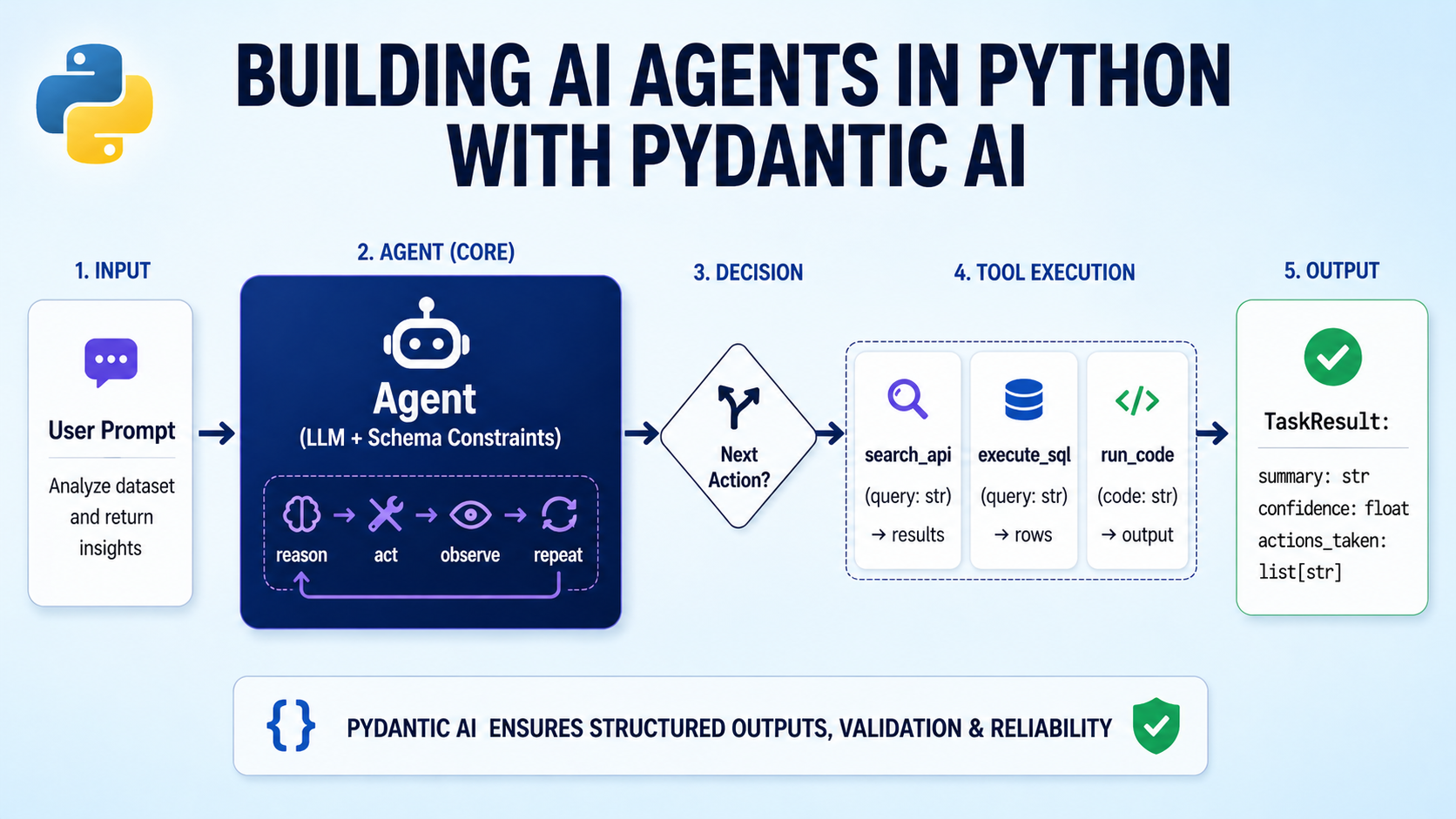

Pydantic AIを使用したPythonでのAIエージェント構築ガイドがMachine Learning Masteryで公開

Hacker News·2026年4月29日

大規模言語モデル

SLM — 外部依存なしのターミナルUI型LLMチャットツール

Hacker News·2026年4月29日

AIニュースを毎日お届け

200以上のソースから厳選したAIニュースを毎日無料でお届けします。

無料で始める