← 記事一覧に戻る

大規模言語モデルが人間と同じ「特定の被害者効果」を示す:16の最先端AIモデルの51,955試験で実証

arXiv cs.CL · 2026年4月15日

AI要約

- •Google、Anthropic、OpenAI、Meta、DeepSeekなど9つの組織による16の最先端LLMが、統計データより個別の被害者への物語的説明に対してより多くのリソースを配分する傾向を示した

- •識別可能な被害者効果(IVE)は道徳心理学と行動経済学における最も堅牢な知見の一つであり、AIシステムが人間の感情的な非合理性を継承していることが初めて系統的に実証された

- •人道支援のトリアージ、助成金評価、コンテンツモデレーションなどの重要な意思決定にLLMが使用される中、このバイアスが実務的な問題となる可能性を示唆している

関連記事

大規模言語モデル

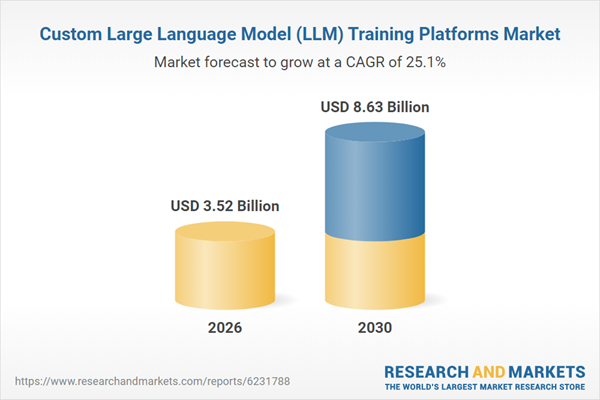

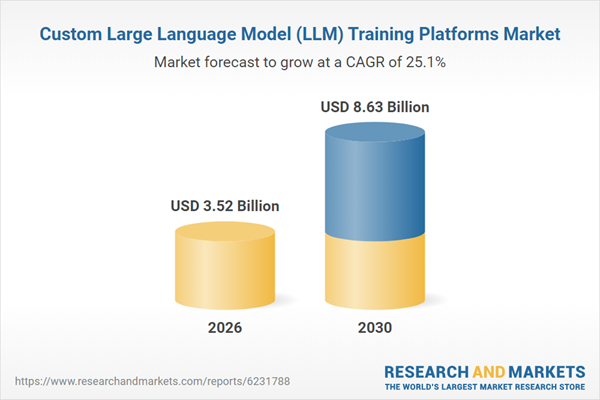

Custom LLM training platforms from AWS, NVIDIA, Microsoft, and OpenAI are positioned for significant growth through 2035, with major opportunities in domain-specific model training and secure cloud deployments.

Yahoo Finance AI·2026年4月20日

AI安全性・アラインメント

AISafety.com launches founder resources page to address organizational bottleneck in AI safety field

LessWrong AI·2026年4月20日

大規模言語モデル

New framework helps developers assess whether their codebases are prepared for AI agent automation and integration.

Hacker News·2026年4月20日

大規模言語モデル

Developer shares curated guide to open-weight language models for production deployment

Hacker News·2026年4月20日

大規模言語モデル

New Email API service enables AI agents to send and receive emails through native Model Context Protocol support

Hacker News·2026年4月20日

AIニュースを毎日お届け

200以上のソースから厳選したAIニュースを毎日無料でお届けします。

無料で始める