← 記事一覧に戻る

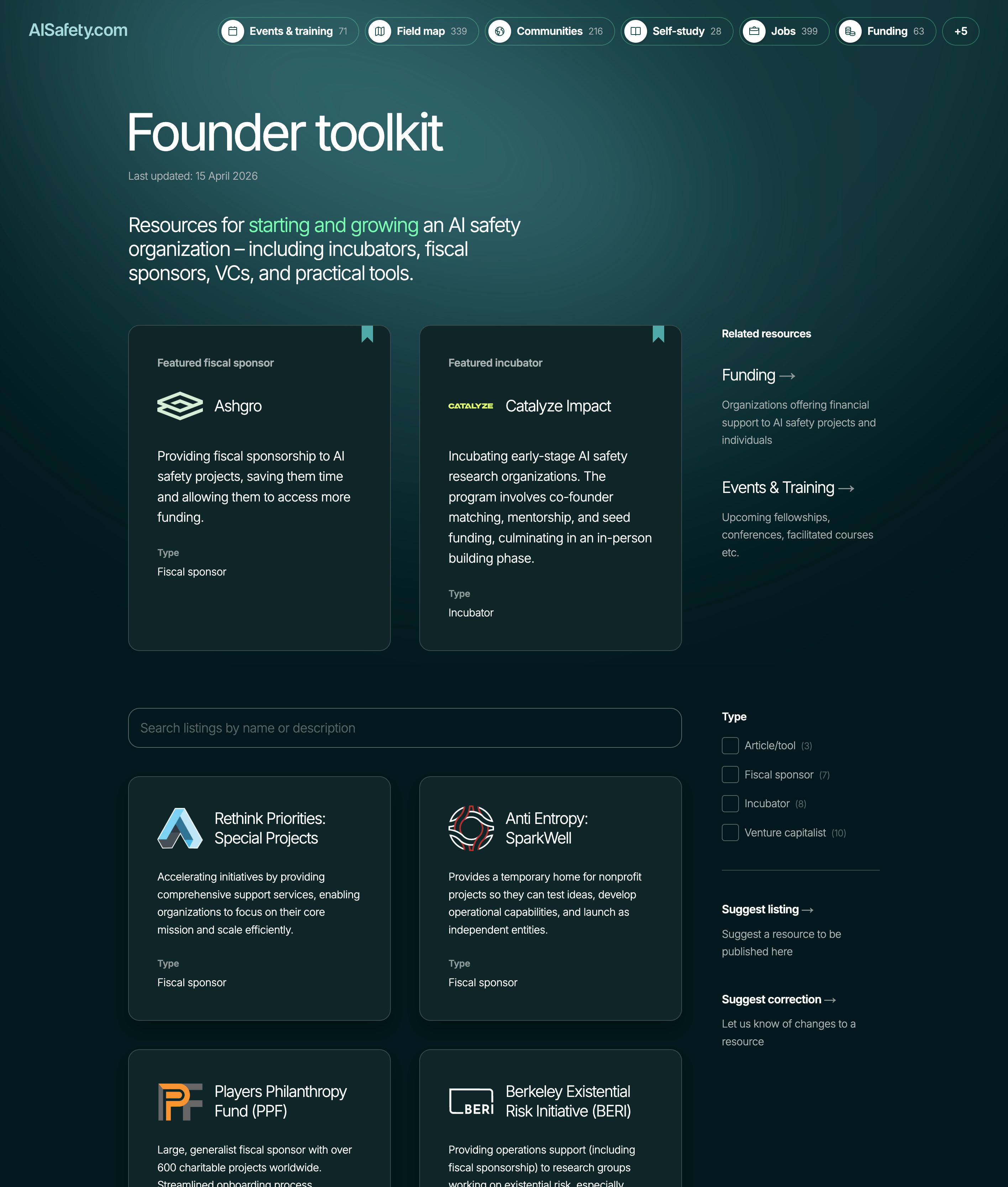

AI安全性組織の設立を支援するため、AISafety.comが創業者向けの資源ページを新たに公開

LessWrong AI · 2026年4月20日

AI要約

- •AI安全性は組織の不足によってボトルネックに直面しており、新規組織の設立を促進することが急務

- •AISafety.com/foundersページでは、資金スポンサー、インキュベーター、ベンチャーキャピタル、記事やツールなどの資源を網羅

- •Ryan Kiddの提案をきっかけに、創業者候補に頻繁に共有されていたリソースを一つのページに統合

- •AISafety.com内の11番目のリソースページで、自己学習コース、コミュニティ、イベント、資金提供者情報なども掲載

- •情報の正確性と最新性を保つため、サイト運営チームが相当なリソースを投入して管理・更新

関連記事

AI安全性・アラインメント

AI安全研究の自動化、中国モデルの安全性評価、HiFloat4が注目される中、金融市場はシンギュラリティをいつ価格に反映させるのか

Import AI·2026年4月20日

AI安全性・アラインメント

Researchers introduce C-Mining, an unsupervised method to automatically discover cultural data seeds for LLMs by measuring cross-lingual embedding misalignment.

arXiv cs.CL·2026年4月20日

AI安全性・アラインメント

New StoSignSGD algorithm fixes SignSGD's convergence problems for training large language models on non-smooth objectives

arXiv cs.LG·2026年4月20日

AI安全性・アラインメント

LLM-based data generators show promise for privacy-preserving synthetic data but struggle with statistical accuracy due to inherent AI biases.

arXiv cs.LG·2026年4月20日

AI安全性・アラインメント

AI安全性研究組織の立ち上げと成長に必要なリソースと実践的ガイドが公開される

Hacker News·2026年4月19日

AIニュースを毎日お届け

200以上のソースから厳選したAIニュースを毎日無料でお届けします。

無料で始める