← 記事一覧に戻る

LLMエージェントの推論劣化を検出・復旧する「認知コンパニオン」アーキテクチャが開発され、ループ現象を52-62%削減

arXiv cs.AI · 2026年4月16日

AI要約

- •LLMエージェントは複数ステップタスクで最大30%の頻度で推論劣化やループ状態に陥る問題が存在

- •LLMベースのコンパニオンは約11%のオーバーヘッドでループ傾向のあるタスクの繰り返しを52-62%削減

- •新しいプローブベースのコンパニオンはレイヤー28の隠れ状態から訓練され、測定可能なオーバーヘッドなしで+0.471の平均効果量を実現

- •Gemma 4 E4B、Qwen 2.5 1.5B、Llama 3.2 1Bなど複数モデルで検証実施

- •プローブベースアプローチは小規模プロキシラベルデータセットでAUROC 0.840の交差検証性能を達成

関連記事

大規模言語モデルオープンソースAI

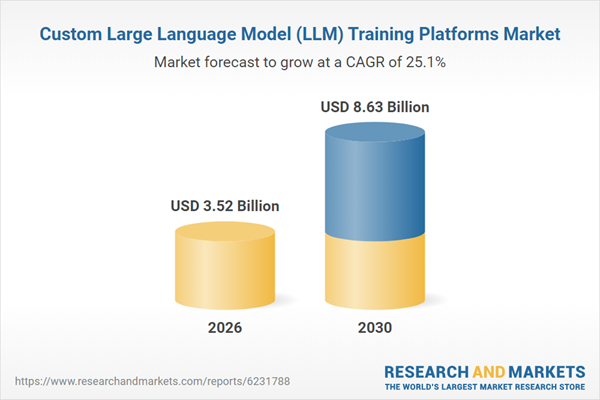

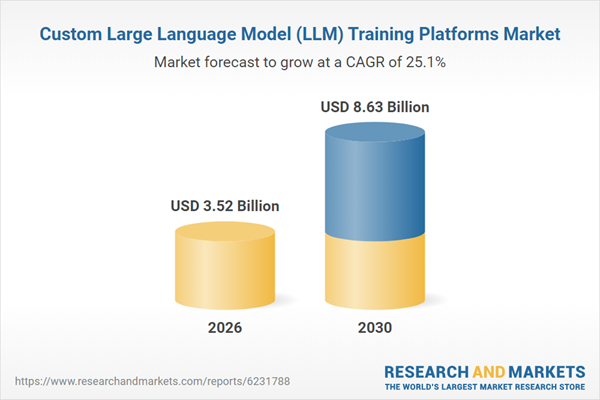

AWS、NVIDIA、Microsoft、OpenAIなどが主導するカスタムLLM訓練プラットフォーム市場は2026年から2035年にかけて急速に拡大予定

Yahoo Finance AI·2026年4月20日

大規模言語モデル

オープンウェイトモデルの厳選ガイドが、本番環境でのLLMデプロイメント実装を支援

Hacker News·2026年4月20日

大規模言語モデル

AIエージェントがコードベースを扱えるかを評価するための「コードベース準備グリッド」がGitHubで公開された

Hacker News·2026年4月20日

大規模言語モデル

AI エージェントの動作を可視化・監視することが、信頼性の高いシステム構築に不可欠となっている。

Hacker News·2026年4月20日

大規模言語モデルオープンソースAI

PythonとOllamaを使用してキーボードショートカットでローカルAIスキルを実行するツール「Scryptian」がHackerNewsで紹介される

Hacker News·2026年4月20日

AIニュースを毎日お届け

200以上のソースから厳選したAIニュースを毎日無料でお届けします。

無料で始める