← 記事一覧に戻る

静的な価値観の設定だけでは不十分:AI の能力向上に伴う堅牢なアライメント実現の課題

arXiv cs.MA (Multi-Agent) · 2026年4月17日

AI要約

- •固定された形式的な価値目標(報酬関数、効用関数、憲法的原則など)への最適化では、能力スケーリングと分布シフトの下で堅牢なアライメントを実現できない

- •ヒュームのis-ought間隙、ベルリンの価値多元主義、拡張フレーム問題の3つの哲学的問題が複合的な困難を生み出す

- •RLHF、Constitutional AI、逆強化学習、協力的支援ゲームなどの全てのアプローチが本質的な脆弱性を抱えており、単なるエンジニアリング改善では解決できない

関連記事

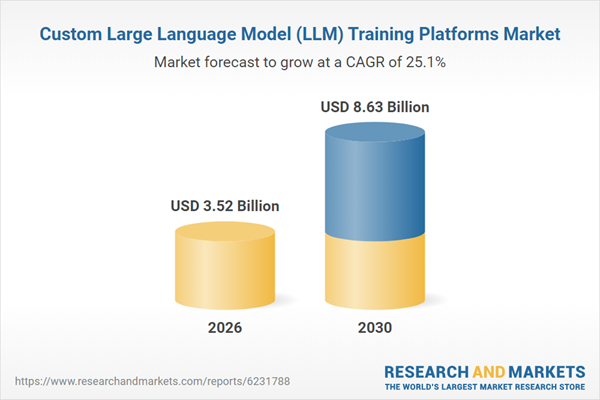

大規模言語モデル

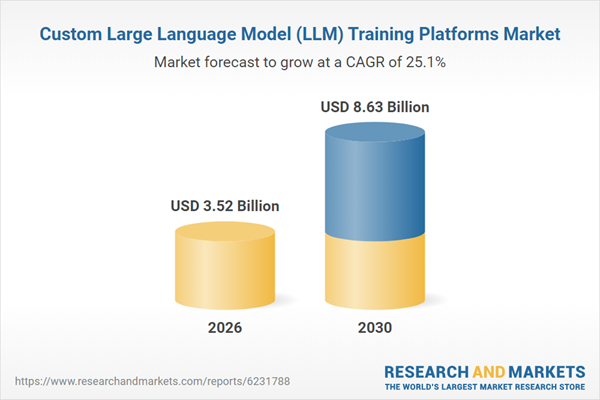

Custom LLM training platforms from AWS, NVIDIA, Microsoft, and OpenAI are positioned for significant growth through 2035, with major opportunities in domain-specific model training and secure cloud deployments.

Yahoo Finance AI·2026年4月20日

AI安全性・アラインメント

AISafety.com launches founder resources page to address organizational bottleneck in AI safety field

LessWrong AI·2026年4月20日

大規模言語モデル

New framework helps developers assess whether their codebases are prepared for AI agent automation and integration.

Hacker News·2026年4月20日

大規模言語モデル

Developer shares curated guide to open-weight language models for production deployment

Hacker News·2026年4月20日

大規模言語モデル

New Email API service enables AI agents to send and receive emails through native Model Context Protocol support

Hacker News·2026年4月20日

AIニュースを毎日お届け

200以上のソースから厳選したAIニュースを毎日無料でお届けします。

無料で始める