← 記事一覧に戻る

ローカルLLaMAユーザーが古いハードウェア上でQwen3を実行する際のプロンプト処理速度の課題について議論

r/LocalLLaMA · 2026年4月19日

AI要約

- •ユーザーが4つのV100 GPUを搭載した古いハードウェア上でQwen3モデルを最適化しようとしている

- •Flash Attentionの欠落により、長いコンテキスト処理時に処理速度が大幅に低下する問題が発生

- •エージェント型コーディング作業に必要な許容可能な処理速度とコンテキスト長についてのコミュニティの意見を求めている

関連記事

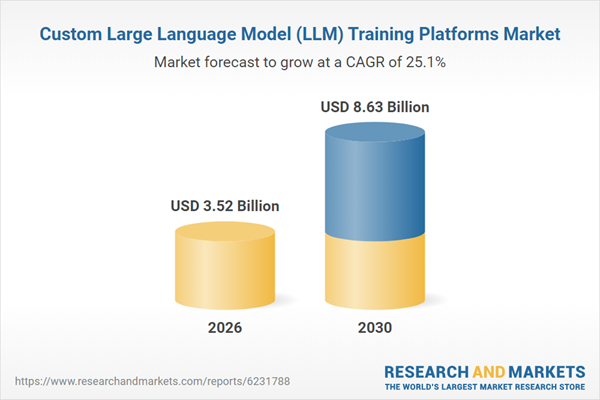

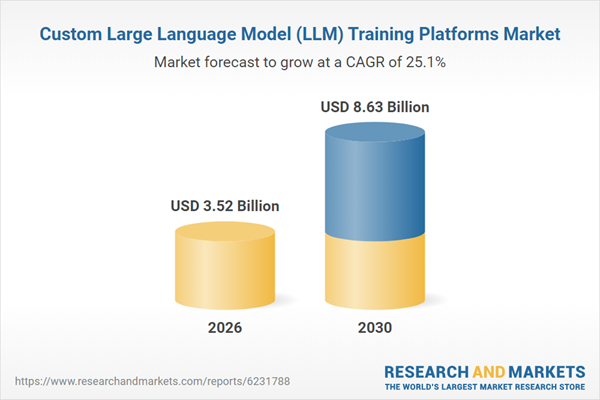

大規模言語モデル

AWS、NVIDIA、Microsoft、OpenAIなどが主導するカスタムLLM訓練プラットフォーム市場は2026年から2035年にかけて急速に拡大予定

Yahoo Finance AI·2026年4月20日

大規模言語モデル

オープンウェイトモデルの厳選ガイドが、本番環境でのLLMデプロイメント実装を支援

Hacker News·2026年4月20日

大規模言語モデル

AIエージェントがコードベースを扱えるかを評価するための「コードベース準備グリッド」がGitHubで公開された

Hacker News·2026年4月20日

大規模言語モデル

AI エージェントの動作を可視化・監視することが、信頼性の高いシステム構築に不可欠となっている。

Hacker News·2026年4月20日

大規模言語モデル

PythonとOllamaを使用してキーボードショートカットでローカルAIスキルを実行するツール「Scryptian」がHackerNewsで紹介される

Hacker News·2026年4月20日

AIニュースを毎日お届け

200以上のソースから厳選したAIニュースを毎日無料でお届けします。

無料で始める