← 記事一覧に戻る

大規模言語モデルが人間と同じ作業記憶の干渉を示す現象が明らかに

arXiv cs.LG · 2026年4月14日

AI要約

- •LLMは注意機構を通じて完全な文脈にアクセス可能にもかかわらず、人間と同様の作業記憶の制限を示している

- •2層トランスフォーマーは作業記憶タスクを完璧に解くことができるが、事前学習済みのLLMは継続して制限を展示する

- •メモリ負荷の増加に伴いパフォーマンスが低下し、最近性と刺激統計による偏りが観察されるなど、人間と同じ干渉シグネチャが再現されている

- •モデル全体において、より強い作業記憶容量はより広い能力と相関関係がある

関連記事

大規模言語モデル

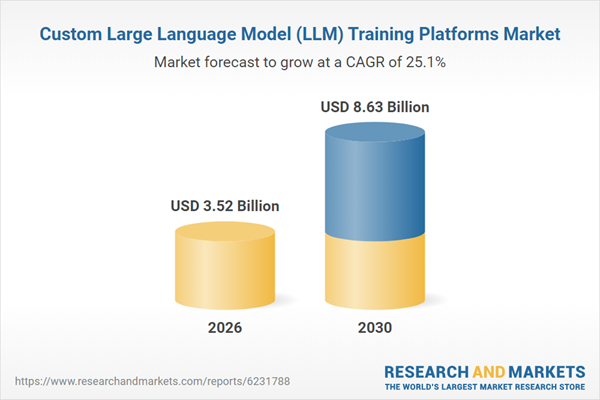

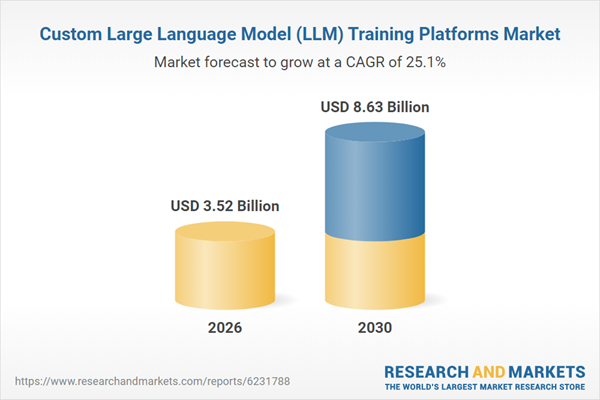

AWS、NVIDIA、Microsoft、OpenAIなどが主導するカスタムLLM訓練プラットフォーム市場は2026年から2035年にかけて急速に拡大予定

Yahoo Finance AI·2026年4月20日

AI安全性・アラインメント

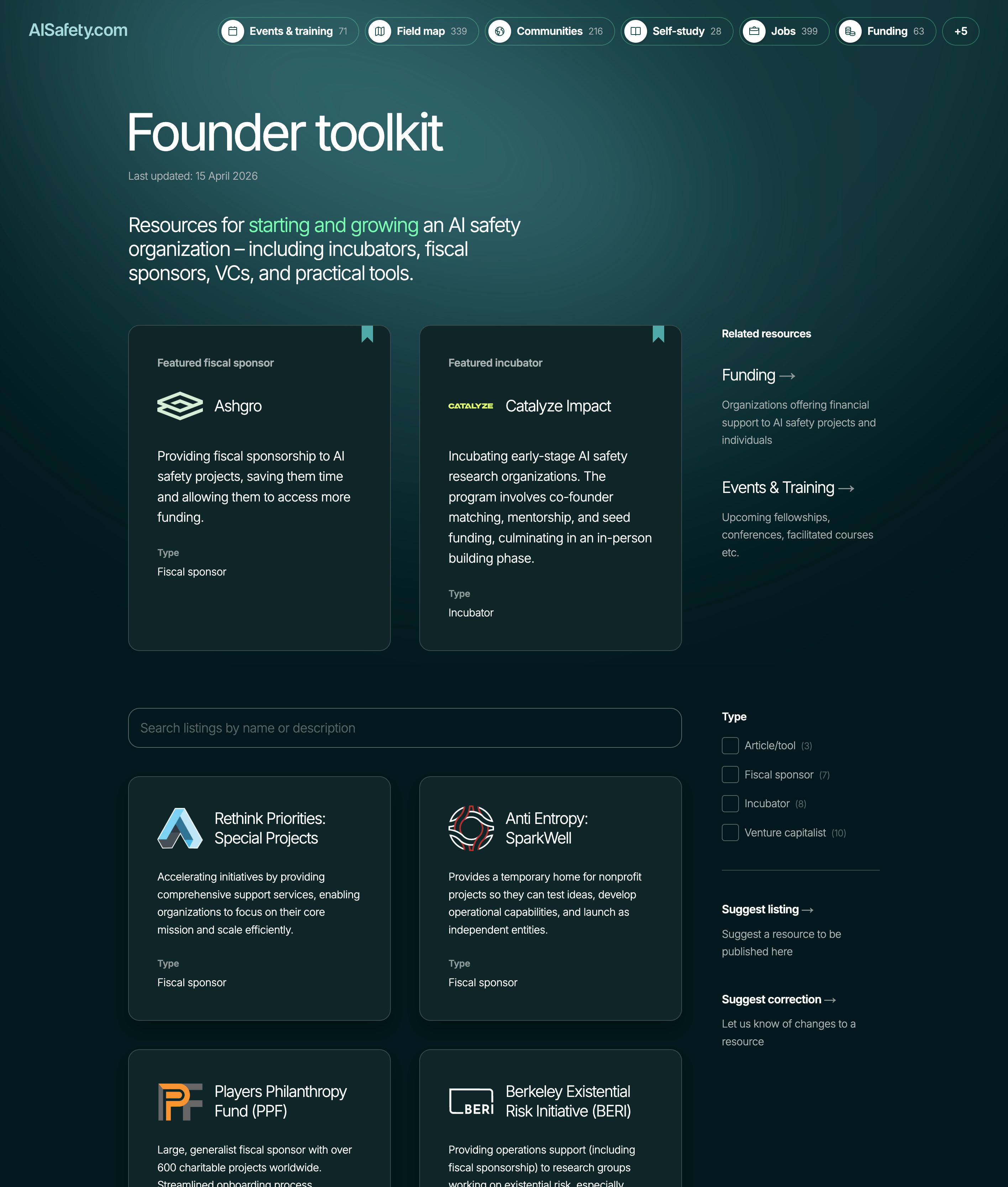

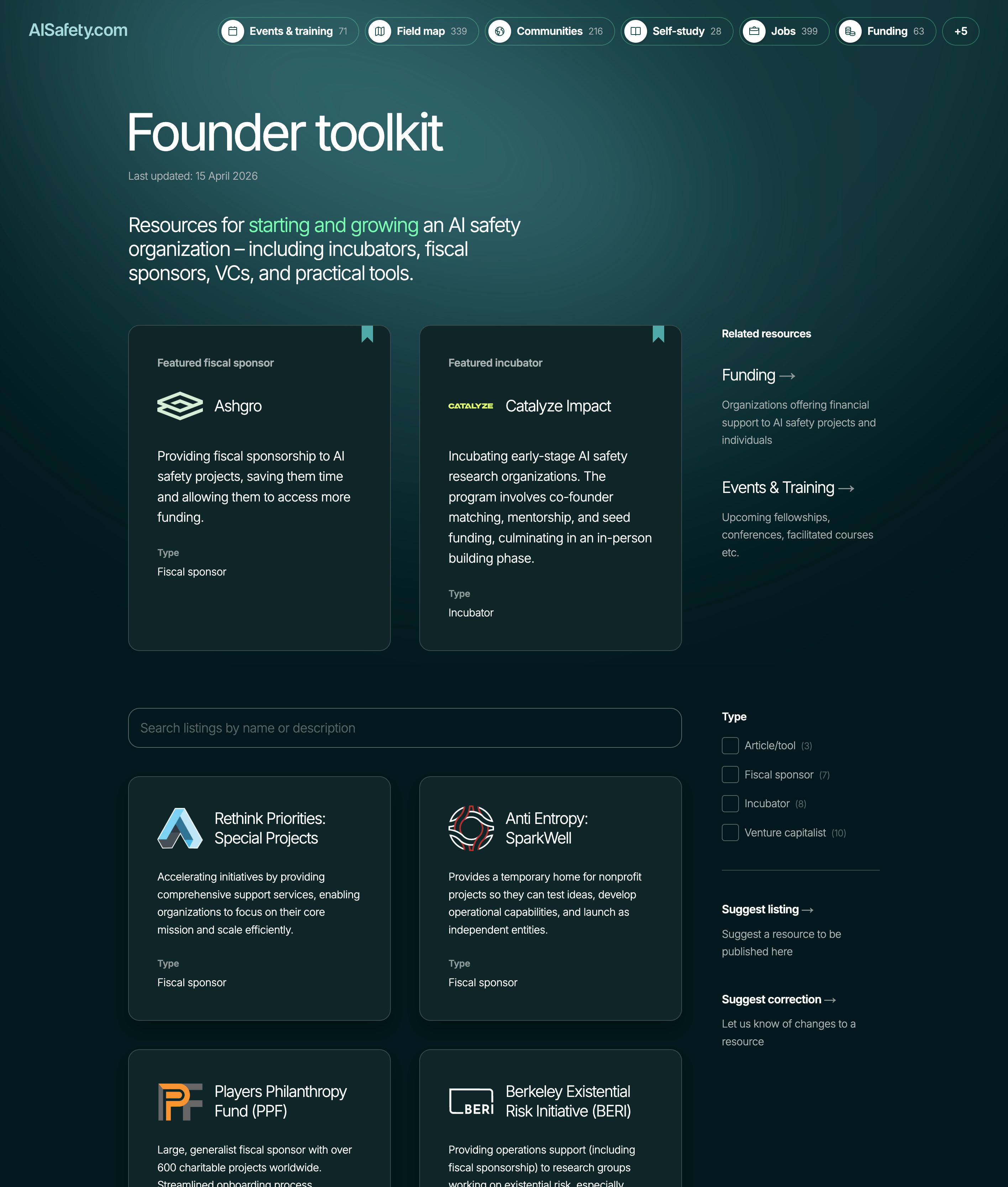

AI安全性組織の設立を支援するため、AISafety.comが創業者向けの資源ページを新たに公開

LessWrong AI·2026年4月20日

大規模言語モデル

オープンウェイトモデルの厳選ガイドが、本番環境でのLLMデプロイメント実装を支援

Hacker News·2026年4月20日

大規模言語モデル

AIエージェントがコードベースを扱えるかを評価するための「コードベース準備グリッド」がGitHubで公開された

Hacker News·2026年4月20日

大規模言語モデル

AI エージェントの動作を可視化・監視することが、信頼性の高いシステム構築に不可欠となっている。

Hacker News·2026年4月20日

AIニュースを毎日お届け

200以上のソースから厳選したAIニュースを毎日無料でお届けします。

無料で始める