← 記事一覧に戻る

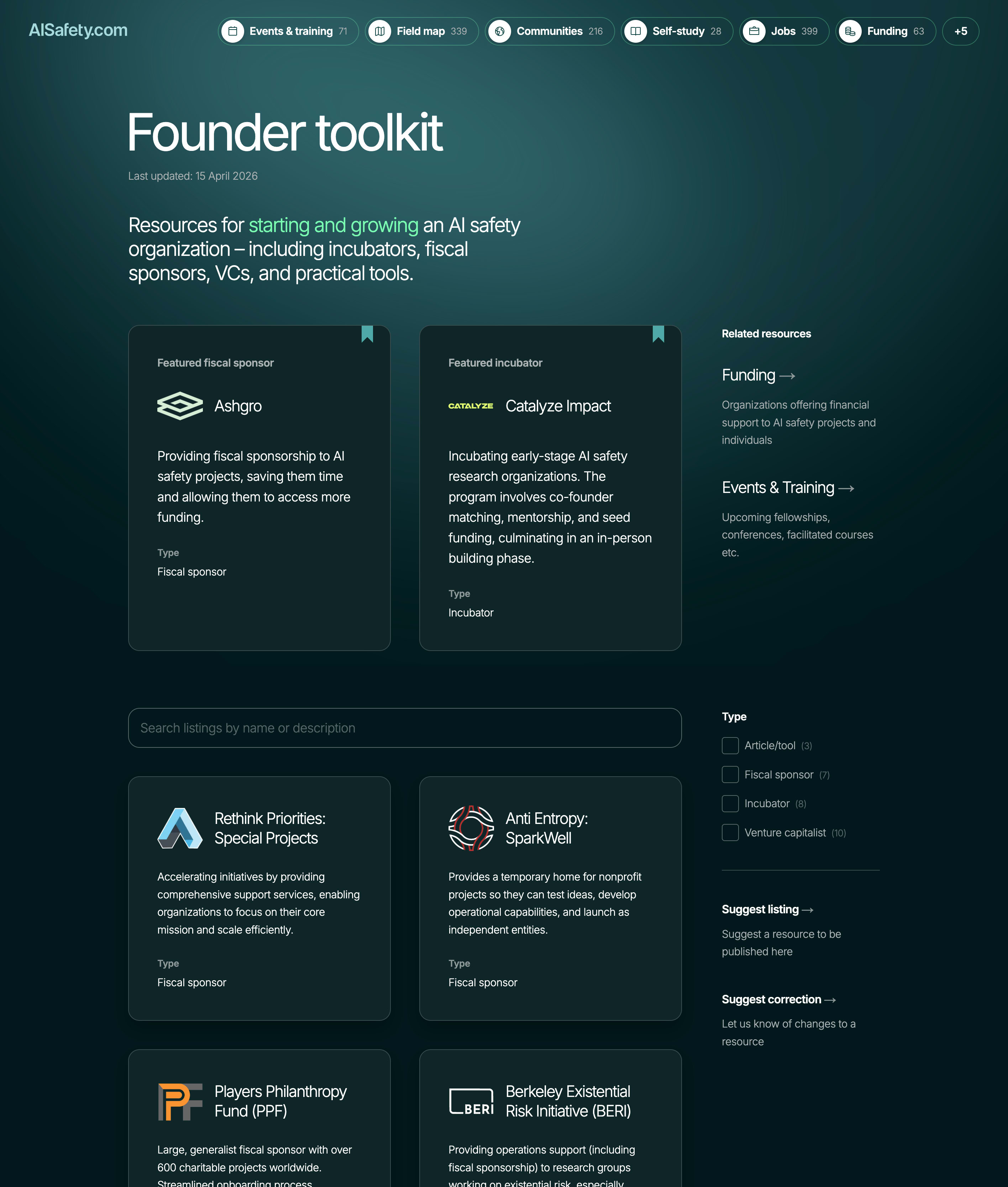

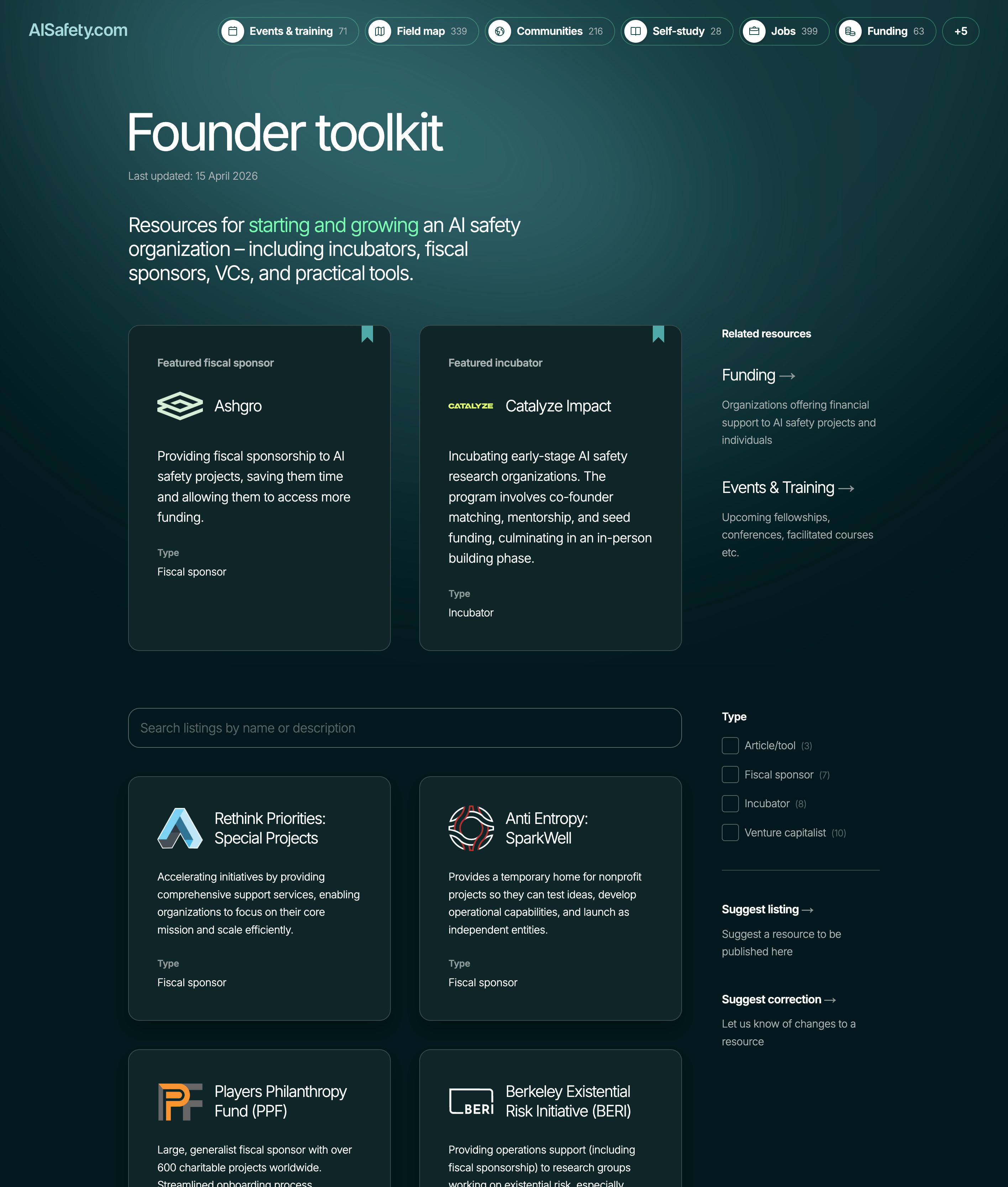

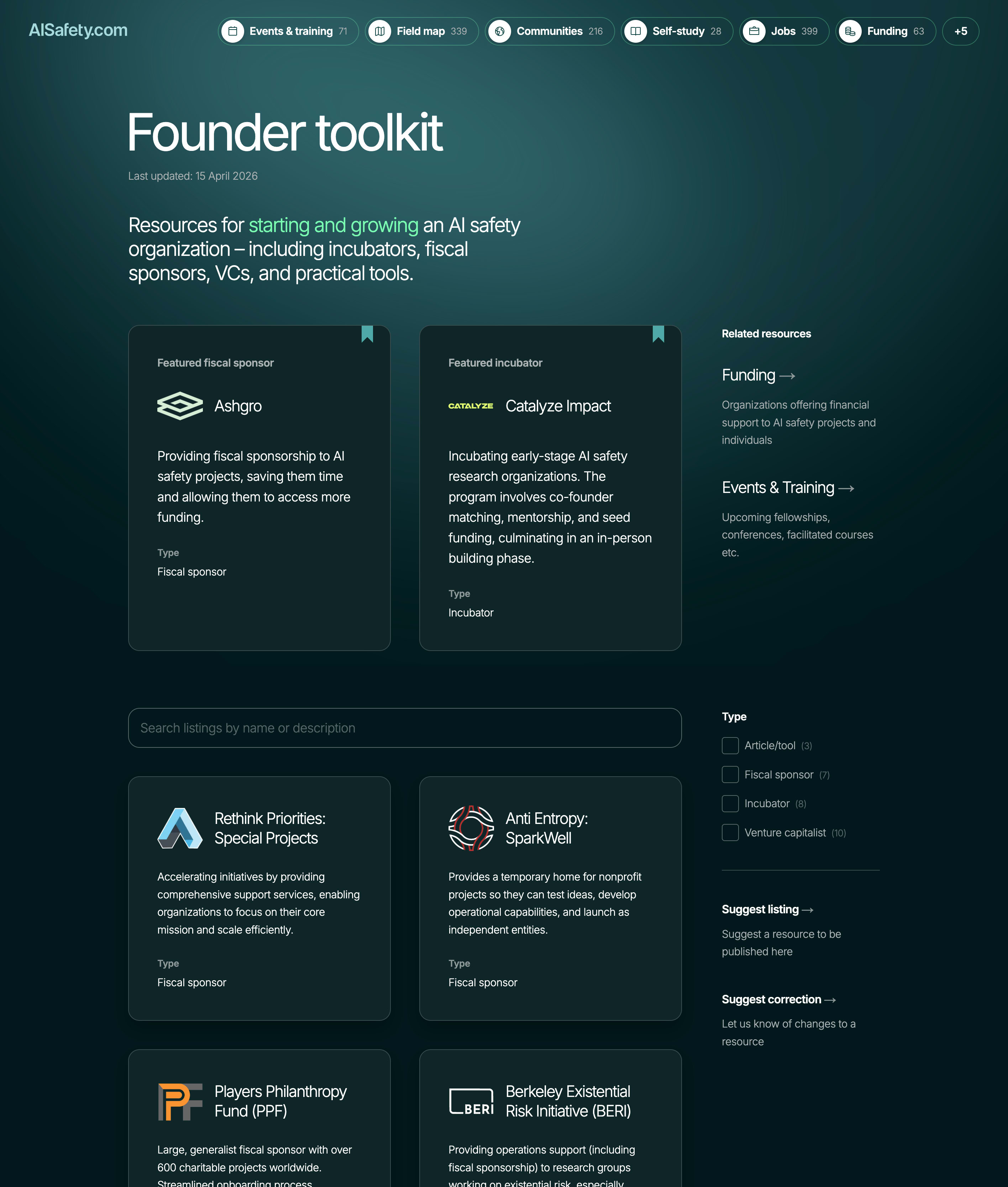

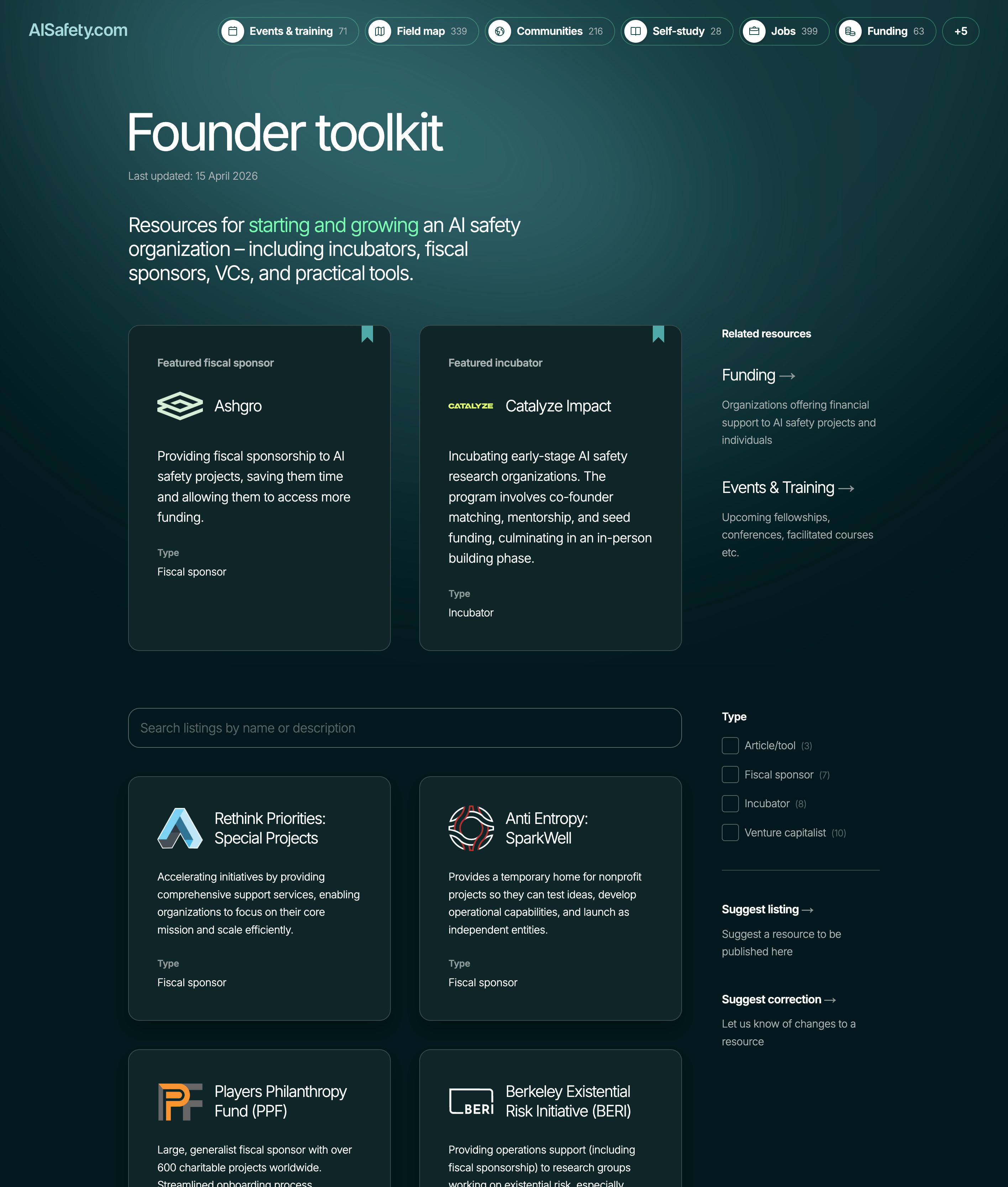

AI安全性研究組織の立ち上げと成長に必要なリソースと実践的ガイドが公開される

Hacker News · 2026年4月19日

AI要約

- •AI安全性に特化した新規組織の設立を検討する人向けの包括的なリソースが提供されている

- •組織運営に必要な資金調達、人材採用、研究戦略などの実践的なアドバイスが含まれている

- •既存のAI安全性組織の事例研究と成功事例から学べるベストプラクティスが紹介されている

関連記事

AI安全性・アラインメント

AISafety.com launches founder resources page to address organizational bottleneck in AI safety field

LessWrong AI·2026年4月20日

AI安全性・アラインメント

AI安全研究の自動化、中国モデルの安全性評価、HiFloat4が注目される中、金融市場はシンギュラリティをいつ価格に反映させるのか

Import AI·2026年4月20日

AI安全性・アラインメント

Researchers introduce C-Mining, an unsupervised method to automatically discover cultural data seeds for LLMs by measuring cross-lingual embedding misalignment.

arXiv cs.CL·2026年4月20日

AI安全性・アラインメント

New StoSignSGD algorithm fixes SignSGD's convergence problems for training large language models on non-smooth objectives

arXiv cs.LG·2026年4月20日

AI安全性・アラインメント

LLM-based data generators show promise for privacy-preserving synthetic data but struggle with statistical accuracy due to inherent AI biases.

arXiv cs.LG·2026年4月20日

AIニュースを毎日お届け

200以上のソースから厳選したAIニュースを毎日無料でお届けします。

無料で始める