← 記事一覧に戻る

強化学習におけるエントロピー制御方法の比較分析により、従来の正則化手法の限界と共分散ベース手法の優位性が明らかに

arXiv cs.LG · 2026年4月14日

AI要約

- •大規模言語モデル(LLM)の推論向上に用いられる強化学習で、ポリシーエントロピーの急速な崩壊による性能飽和が課題

- •従来のエントロピー正則化は密集した持続的バイアスを導入し、最適でない方針につながることを理論的に証明

- •共分散ベースの新しい方法は高共分散トークンのみを選別的に正則化し、漸近的な不偏性を実現

- •ソフトマックスパラメータ化におけるエントロピー動態の統一的フレームワークを確立し、ログ確率とロジット更新の共分散が制御の鍵であることを示唆

関連記事

大規模言語モデル

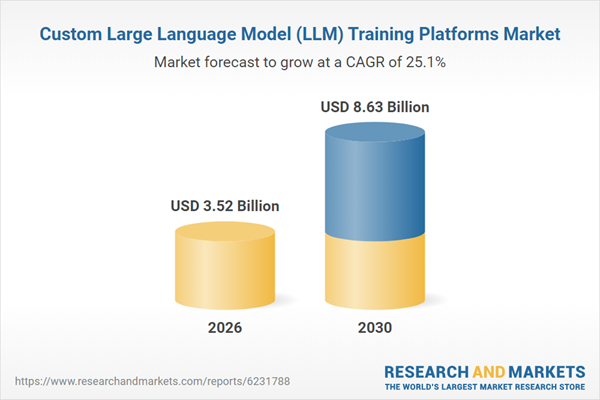

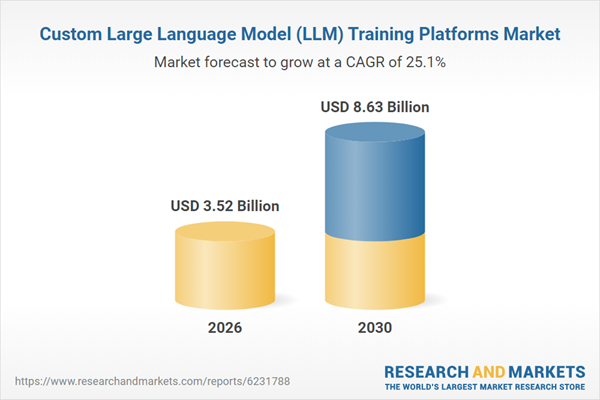

AWS、NVIDIA、Microsoft、OpenAIなどが主導するカスタムLLM訓練プラットフォーム市場は2026年から2035年にかけて急速に拡大予定

Yahoo Finance AI·2026年4月20日

AI安全性・アラインメント

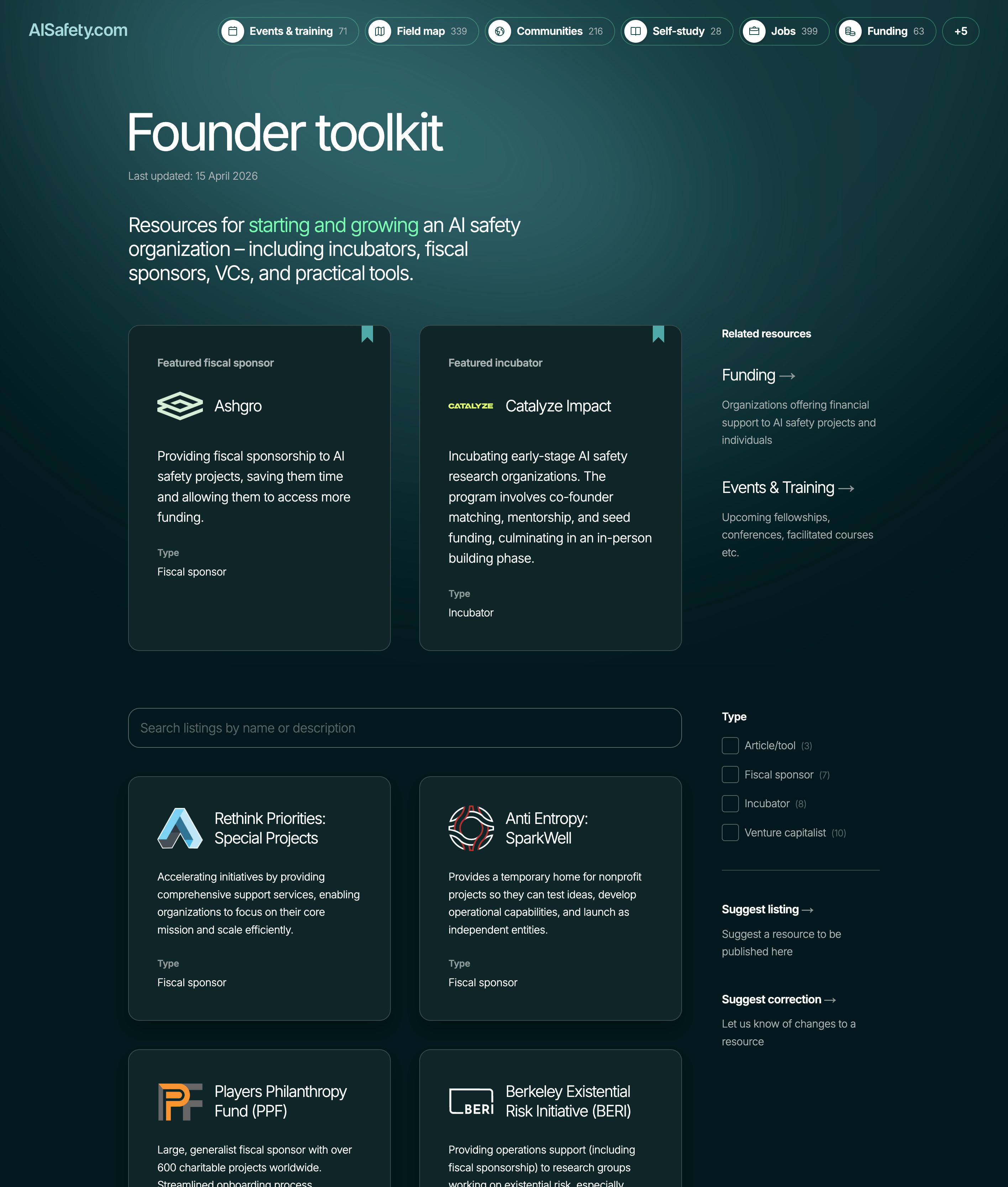

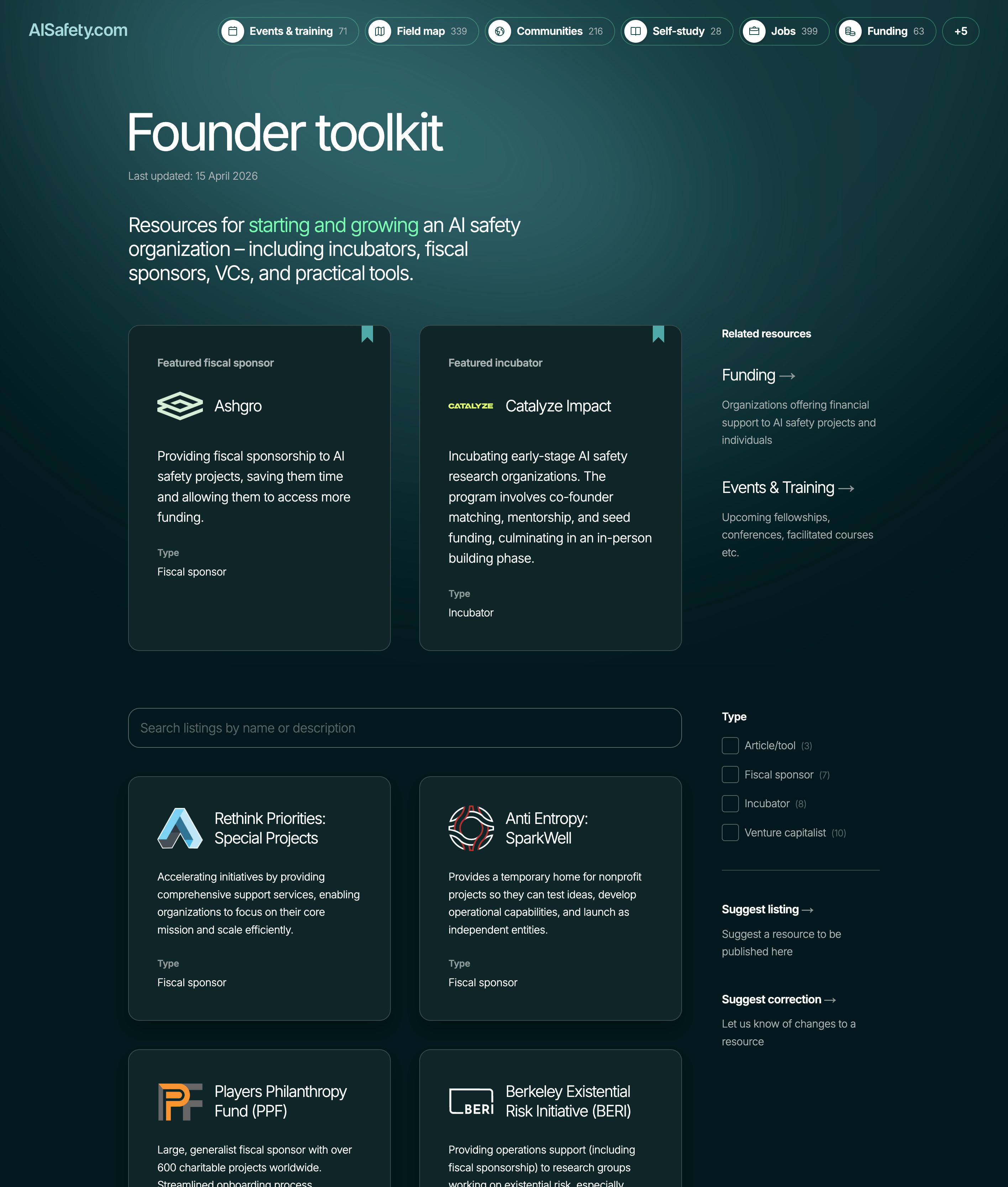

AI安全性組織の設立を支援するため、AISafety.comが創業者向けの資源ページを新たに公開

LessWrong AI·2026年4月20日

大規模言語モデル

オープンウェイトモデルの厳選ガイドが、本番環境でのLLMデプロイメント実装を支援

Hacker News·2026年4月20日

大規模言語モデル

AIエージェントがコードベースを扱えるかを評価するための「コードベース準備グリッド」がGitHubで公開された

Hacker News·2026年4月20日

大規模言語モデル

AI エージェントの動作を可視化・監視することが、信頼性の高いシステム構築に不可欠となっている。

Hacker News·2026年4月20日

AIニュースを毎日お届け

200以上のソースから厳選したAIニュースを毎日無料でお届けします。

無料で始める